什麼是 RunPod?

RunPod 是一個為 AI 和機器學習設計的雲端計算平台。它提供價格合理且易於使用的 GPU 雲服務、無伺服器 GPU 計算和 AI 端點,且不會影響效能。用戶可以創建按需 GPU 實例、構建自動擴展 API 端點和部署自定義模型。它服務於新創公司、學術機構和企業。

RunPod 的主要功能

RunPod 為 AI 模型的開發、訓練和部署提供經濟高效且可擴展的基礎架構。它提供 GPU 和 CPU 資源、無伺服器計算和用戶友好的部署工具,包括即時 GPU 存取、自動擴展、作業佇列和即時分析。

自定義環境:支援自定義容器和超過 50 個為各種 ML 架構和工具預先配置的模板。

CLI 和熱重載:強大的 CLI 工具支持本地開發,並具有熱重載功能,實現無縫雲部署。

綜合分析:即時使用分析、詳細指標和實時日誌,用於監控和除錯端點和工作器。

無伺服器 AI 推理:自動擴展的 GPU 工作器每天處理數百萬個推理請求,冷啟動時間低於 250 毫秒。

即時 GPU 存取:可在幾秒鐘內啟動 GPU Pod,從而減少冷啟動時間,加快開發和部署速度。

RunPod 的使用案例

AI 模型訓練:在高性能 GPU 上進行資源密集型機器學習模型的訓練。

大型語言模型部署:託管和擴展大型語言模型,用於聊天機器人或文本生成服務等應用程序。

實時 AI 推理:將 AI 模型部署到實時推理應用程序中,例如推薦系統或欺詐檢測。

計算機視覺處理:為自動駕駛汽車或醫學影像等行業運行圖像和視頻處理任務。

RunPod 優缺點

- 易於使用的介面和開發工具,方便快速設置和部署。

- 與其他雲提供商相比,GPU 存取成本更低。

- 靈活的部署選項,提供按需和無伺服器服務。

- 一些用戶報告說,與其他平台相比,某些任務的處理時間較長。

- 一些長期用戶報告偶爾會出現服務質量波動。

- 試用用戶退款選項有限。

RunPod 常見問題

什麼是 RunPod?

RunPod 是一個用於 AI 和機器學習應用的雲端計算平台。它提供 GPU 和 CPU 資源、無伺服器計算以及用於開發、訓練和擴展 AI 模型的工具。

RunPod 的定價機制如何?

RunPod 使用按使用量付費模式。GPU 實例按小時計費,費用根據 GPU 類型而異;無伺服器使用量按請求計費。需要至少充值 10 美元。

RunPod 提供哪些類型的 GPU?

RunPod 提供各種 GPU,包括 NVIDIA H100、A100、A40、L40、RTX A6000、RTX 4090、RTX 3090 和 AMD MI300X。安全雲和社區雲的價格和可用性有所不同。

安全雲和社區雲有什麼區別?

安全雲在企業級數據中心提供高可靠性基礎架構,而社區雲提供點對點 GPU 計算,價格可能更低,但正常運行時間的保證較少。

RunPod 提供免費試用嗎?

RunPod 目前不提供免費試用或信用額度,但用戶可以從 10 美元的最低帳戶充值開始。

RunPod 的無伺服器 GPU 服務如何工作?

RunPod 的無伺服器 GPU 服務提供自動擴展、作業佇列和快速的冷啟動時間(低於 250 毫秒),可根據需求從 0 個擴展到數百個 GPU。

RunPod 提供哪些開發工具?

RunPod 提供網頁介面、CLI 工具 (runpodctl) 和 GraphQL、JavaScript 和 Python 的 SDK。CLI 支持本地開發的熱重載。

RunPod 如何處理安全性和合規性?

RunPod 的安全雲數據中心符合 Tier 3 或 Tier 4 標準,並優先考慮安全措施。有關具體合規性詳情,請聯繫 RunPod。

對這款產品感興趣?

更新於 2026-02-05

🔍 發現更多工具

AI調色盤是一款AI驅動的工具,旨在幫助您為您的標誌、插圖、線框圖和其他圖形設計找到完美的配色方案。通過上傳您的平面設計,該工具會根據古典和現代藝術風格自動生成數千種獨特的顏色變化。這就像隨時隨地擁有一支色彩專家團隊,為您的下一個創意項目提供靈感和指導。

Beatoven.ai 是一個由 AI 驅動的平台,用於創建自定義的免版稅音樂。專為內容創作者設計,它提供了各種風格和情緒,以完美匹配任何專案。通過由 AI 輕鬆生成的高品質配樂,簡化您的工作流程。

FlowHunt 是一個用於構建和管理 AI 工具和聊天機器人的無程式碼平台。其可視化介面讓使用者無需程式設計即可建立自動化工作流程和 AI 代理。這個平台專為旨在輕鬆將 AI 整合到其流程中的不同行業的用戶而設計。

Cursor AI 編輯器是一款功能強大的 AI 驅動程式碼編輯器,旨在通過整合先進的人工智慧功能來增強程式碼編寫體驗。它基於 Visual Studio Code 的分支版本構建,提供智慧程式碼自動完成、預測式編輯和自然語言指令,使其成為各級開發人員的寶貴工具。

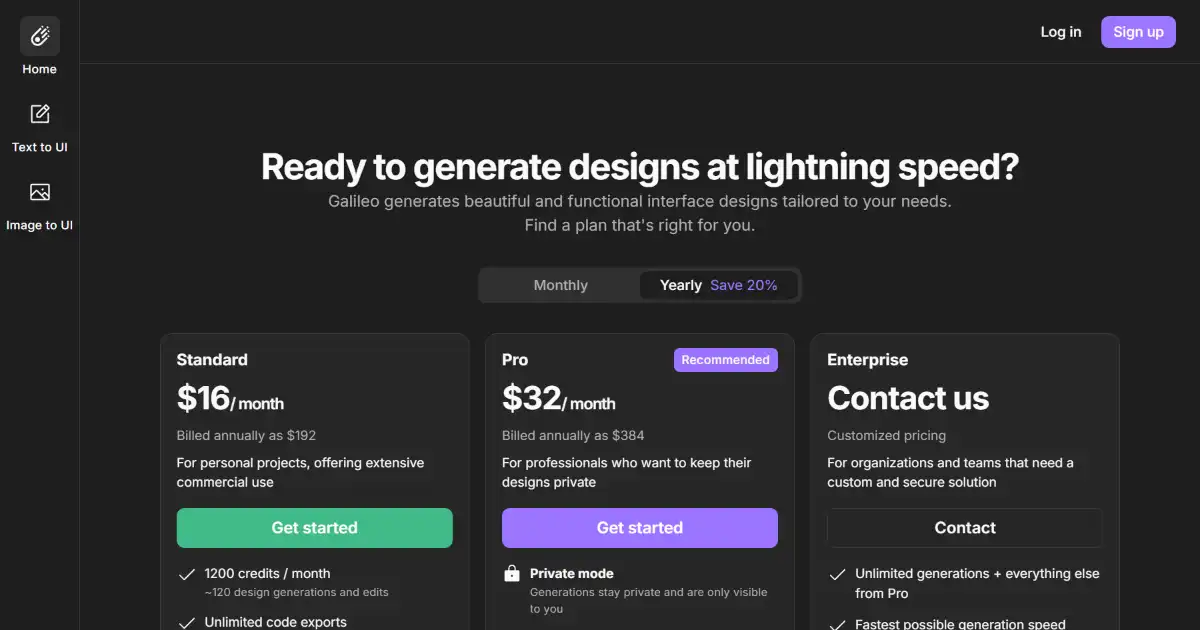

Galileo AI 是一種 AI 驅動的設計工具,可從文字描述和圖像創建可編輯的 UI 設計。它可以快速生成完整的 UI,從而節省設計師的大量時間。這種高效的工作流程使您可以專注於高影響力的設計決策,而不是手動工作。

ThumbnailAi 是一種人工智慧驅動的工具,可幫助內容創作者優化其 YouTube 縮圖。它提供數據驅動的見解,以改善視覺吸引力並提高點擊率,從而允許做出明智的設計決策。